AI賦能網站內容 應用實踐與倫理考量

隨著人工智能技術的飛速發展,其在網站內容處理與相關應用軟件開發中的作用日益凸顯。從自動化內容生成到個性化推薦,從智能客服到內容審核,人工智能正在重塑網站運營的范式。這種技術賦能也伴隨著一系列值得深思的挑戰與擔憂。

一、人工智能在網站內容處理中的核心應用

- 內容生成與創作:基于自然語言處理(NLP)和大型語言模型(LLM),AI能夠自動撰寫新聞稿、產品描述、博客文章甚至營銷文案。這極大提升了內容生產的效率,尤其在需要大規模、標準化或快速響應(如財經、體育快訊)的場景中。

- 內容理解與分類:AI可以自動分析海量文本、圖像和視頻內容,提取關鍵信息、情感傾向和主題標簽,實現內容的自動分類、打標簽和結構化組織,從而優化網站的信息架構和搜索引擎優化(SEO)。

- 個性化推薦與用戶體驗優化:通過機器學習算法分析用戶行為數據(如瀏覽歷史、點擊記錄、停留時間),AI能夠構建精準的用戶畫像,并實時推薦其可能感興趣的文章、產品或服務,顯著提升用戶參與度和轉化率。

- 內容審核與安全:AI模型(特別是計算機視覺和NLP)可以7x24小時不間斷地識別和過濾網站上的違規內容,如垃圾信息、仇恨言論、虛假新聞和敏感圖片,維護網絡環境的健康與安全。

- 智能交互與客服:集成聊天機器人(Chatbot)和虛擬助手,能夠提供全天候的即時問答、故障排查和業務引導,減輕人工客服壓力,提升服務可及性。

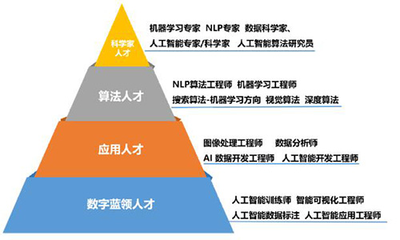

二、人工智能應用軟件開發的關鍵趨勢

圍繞上述應用,AI應用軟件的開發呈現出以下趨勢:

- 低代碼/無代碼平臺興起:為了讓非技術背景的網站運營者也能利用AI能力,提供可視化拖拽和預置模型調用的開發平臺越來越流行。

- API與微服務化:AI能力(如語義分析、圖像識別、語音合成)正以云API或微服務的形式被封裝,方便開發者快速集成到現有網站系統中。

- 邊緣計算與實時處理:為了降低延遲和保護隱私,部分AI處理任務(如初步內容過濾)正從云端向用戶終端或邊緣服務器轉移。

- 模型即服務(MaaS):開發者可以直接調用和微調由大型科技公司提供的先進預訓練模型,降低了從零開始訓練模型的高昂成本和門檻。

三、伴隨而來的主要擔憂與挑戰

盡管前景廣闊,但AI在網站內容領域的深度應用也引發了多方面的擔憂:

- 內容質量與真實性危機:AI生成的內容可能缺乏深度、創造性和事實核查,導致信息過載和“內容洼地”現象。更嚴重的是,深度偽造(Deepfake)技術和AI生成的虛假信息可能被惡意利用,擾亂輿論,損害公眾信任。

- 版權與知識產權歸屬模糊:AI生成的內容是基于大量現有人類作品訓練而來,其產出物的版權歸屬(屬于開發者、使用者還是AI本身?)在法律上仍存在灰色地帶,容易引發糾紛。

- 算法偏見與公平性:如果訓練數據本身存在偏見(如性別、種族歧視),AI系統會放大并固化這些偏見,導致推薦結果不公、審核標準失衡,甚至對特定群體造成傷害。

- 就業沖擊與人類技能退化:自動化內容生產可能沖擊傳統編輯、撰稿人、客服等崗位。過度依賴AI可能導致人類在寫作、批判性思維和創造性表達方面的能力退化。

- 隱私與數據安全風險:為了提供個性化服務,AI系統需要收集和分析海量用戶數據,這增加了數據泄露和濫用的風險,對用戶隱私構成巨大威脅。

- 責任界定與倫理困境:當AI生成的內容造成損害(如誹謗、誤導),或AI做出的審核、推薦決策引發爭議時,責任應由誰承擔——開發者、運營方還是算法本身?這提出了嚴峻的倫理和法律挑戰。

四、走向負責任的人機協同未來

面對機遇與挑戰并存的前景,業界需要采取審慎而積極的態度:

- 技術層面:持續研發可解釋AI(XAI),提高算法透明度;加強數據清洗和偏差檢測,確保訓練數據的多樣性與公平性;開發更強大的事實核查和深度偽造檢測工具。

- 法規與標準層面:政府和國際組織需加快制定關于AI生成內容標識、版權認定、數據使用和算法問責的法律法規與行業標準。

- 實踐層面:網站運營者應明確“人類主導、AI輔助”的原則,對AI生成內容進行嚴格的人工審核與價值注入;向用戶清晰披露AI的參與程度;建立用戶反饋和申訴機制。

人工智能在網站內容處理和應用開發中正釋放出巨大潛力,但其健康發展必須建立在對上述擔憂的深刻認識與系統性應對之上。最終目標應是構建一個AI增強而非替代人類智慧、效率與倫理并重、安全可信的數字內容生態。